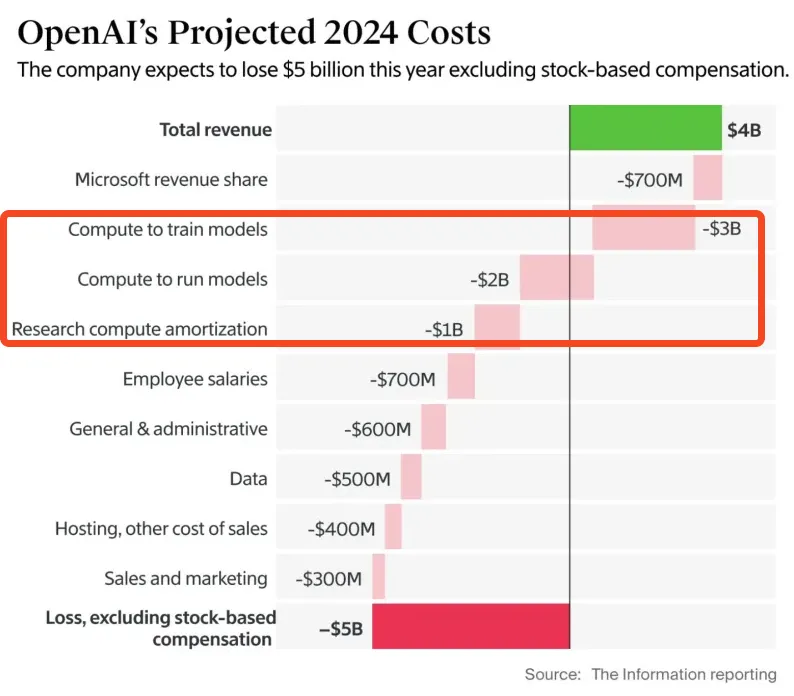

H100 GPU 租金曾达每小时 8-16 美元,不过如今因供应增加和开源模型普及,现降至 1-2 美元。本文源自 Eugene Cheah 所著文章,由 Techhub News 编译,PANews 整理。

AI 算力成本下降,将激发初创公司利用低成本资源进行创新的热潮。去年由于 AI 算力供应紧张,H100 的租赁价格高达每小时 8 美元,但现在市场上算力供应过剩,价格降到了每小时 2 美元以下。

这是由于一些公司在早期签署了算力租赁合约,为了不让过剩的算力浪费,于是开始转售其预留的计算资源,而市场大多选择使用开源模型,导致新模型的需求减少。

现在,市场上 H100 的供应量远超需求,因此租用 H100 比购买更划算,投资购买新的 H100 已不再具有收益。

AI 竞赛简史

GPU 算力市场的价格一路飙升,H100 最初的租金约为每小时 4.70 美元,涨到最高超过 8 美元。这是由于专案创办人为了实现下一轮融资,并说服投资者,必须抓紧时间训练他们的 AI 模型。

ChatGPT 于 2022 年 11 月推出,使用的是 A100 系列的 GPU。到了 2023 年 3 月,NVIDIA 推出了新的 H100 系列 GPU,在其宣传中提到 H100 的效能比 A100 强 3 倍,但价格却只比 A100 高 2 倍。

这对 AI 初创公司来说是一个巨大的吸引力。因为 GPU 的效能直接决定了他们可以开发的 AI 模型的速度和规模。H100 的强大效能意味著这些公司能够开发出比以前更快、更大、更高效的 AI 模型,甚至有可能追赶或超过像 OpenAI 这样的行业领导者。当然,这一切的前提是他们拥有足够的资本来购买或租用大量的 H100。

由于 H100 的效能大大提升,再加上 AI 领域的激烈竞争,很多初创公司都投入了巨额资金来抢购 H100,用它来加速他们的模型训练。这种需求的激增导致 H100 的租赁价格暴涨,最初每小时 4.70 美元,但后来涨到超过 8 美元。

这些初创公司之所以愿意支付高昂的租金,是因为他们急于快速训练模型,以便在下一轮融资中吸引投资者的注意,争取到数亿美元的资金来继续扩展套件他们的业务。

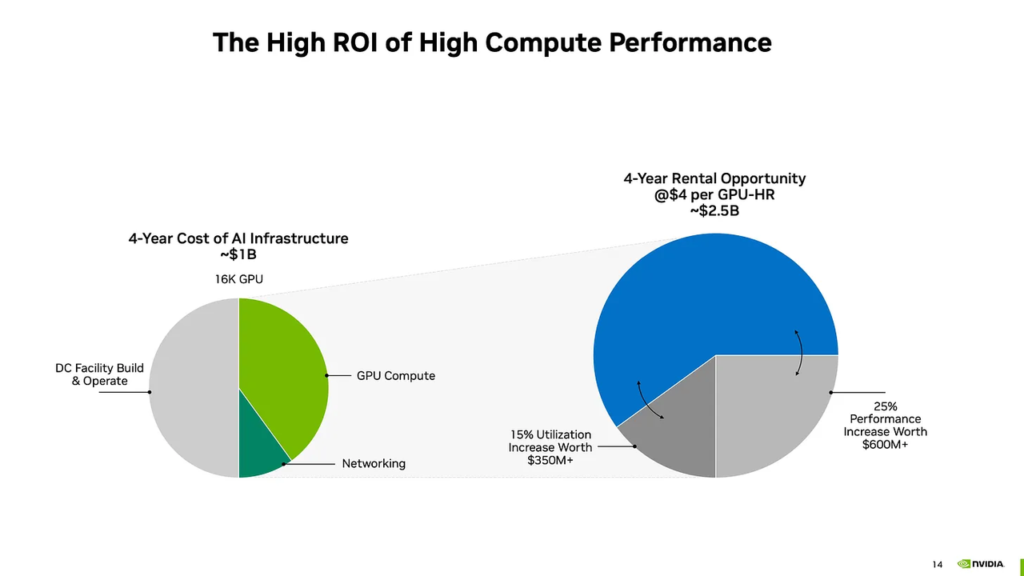

对于拥有大量 H100 GPU 的算力中心(农场)来说,租赁 GPU 的需求非常高,这就像是「送上门来的钱」。原因是这些 AI 初创公司急于租用 H100 来训练他们的模型,甚至愿意预付租金。这意味著 GPU 农场可以以长期的每小时 4.70 美元(或更高)租出他们的 GPU。

根据计算,如果他们能以这种价格持续出租 GPU,那么他们投资购买 H100 的回报周期(即收回购买成本的时间)将不到 1.5 年。回报期结束后,之后每台 GPU 每年能带来超过 10 万美元的净现金流收入。

由于对 H100 和其他高效能 GPU 的需求持续高涨,GPU 农场的投资者看到了巨大的利润空间,因此他们不仅同意了这种商业模式,甚至还追加了更大的投资,购买更多 GPU 以赚取更多利润。